本地部署Deepseek/Qwen等开源大模型

前言

本人姑且也算是一个重度 AI 使用者,基本上遇上什么技术问题都会优先去问 AI,尤其在去年年初 deepseek 上线之后就特别喜欢和 deepseek 聊天,到现在估计总共也给 deepseek 贡献了几十万条聊天记录了。但是使用网页端或者应用端的 AI(特别是 deepseek 和其他一些国产AI的时候)总不免遇到一个问题,就是AI的敏感词,这一点特别是 deepseek 惹得我挺不爽的(毕竟 deepseek 是出了名的求生欲极强),所以从开始搞这个博客开始我就一直想要一个我自己部署的 AI,之前在我最近都搞了些啥?近况公告25#2!里面就讲过我用过官方 API + GitHub 开源 UI 并通过 Vercel 部署这条技术路线上线了我的第一个AI,命名为柠檬星AI,最开始只有 deepseek,后来又搞到了 ChatGPT 的 API,所以现在这个主要是有两个 AI 可以用。但是用 API 依旧还是会遇到内容审查的问题,而且还要花钱(虽然后面找到了一个免费的 API 项目),所以也不是很理想,所以在换电脑之后就想在我的电脑上部署一下看看,结果这台电脑都买了大半年了到现在才开始搞。那么事不宜迟,我们现在就开始吧!

设备信息:

操作系统: Windows 11 家庭中文版 25H2

机型: 机械革命 无界15X 暴风雪

处理器: AMD Ryzen AI 9 H 365

显卡: AMD Radeon 880M Graphics(集显)

Step 1. 下载Ollama

Ollama 是目前最流行的本地部署大语言模型工具,旨在简化繁琐的模型部署流程,只用几行命令就可以完整部署大语言模型,我这次选Ollama也是因为它是所有的工具里面最好用教程也最多的,而且模型库很完整,反正就是非常方便,虽然没有什么繁琐的操作有点不够极客范?

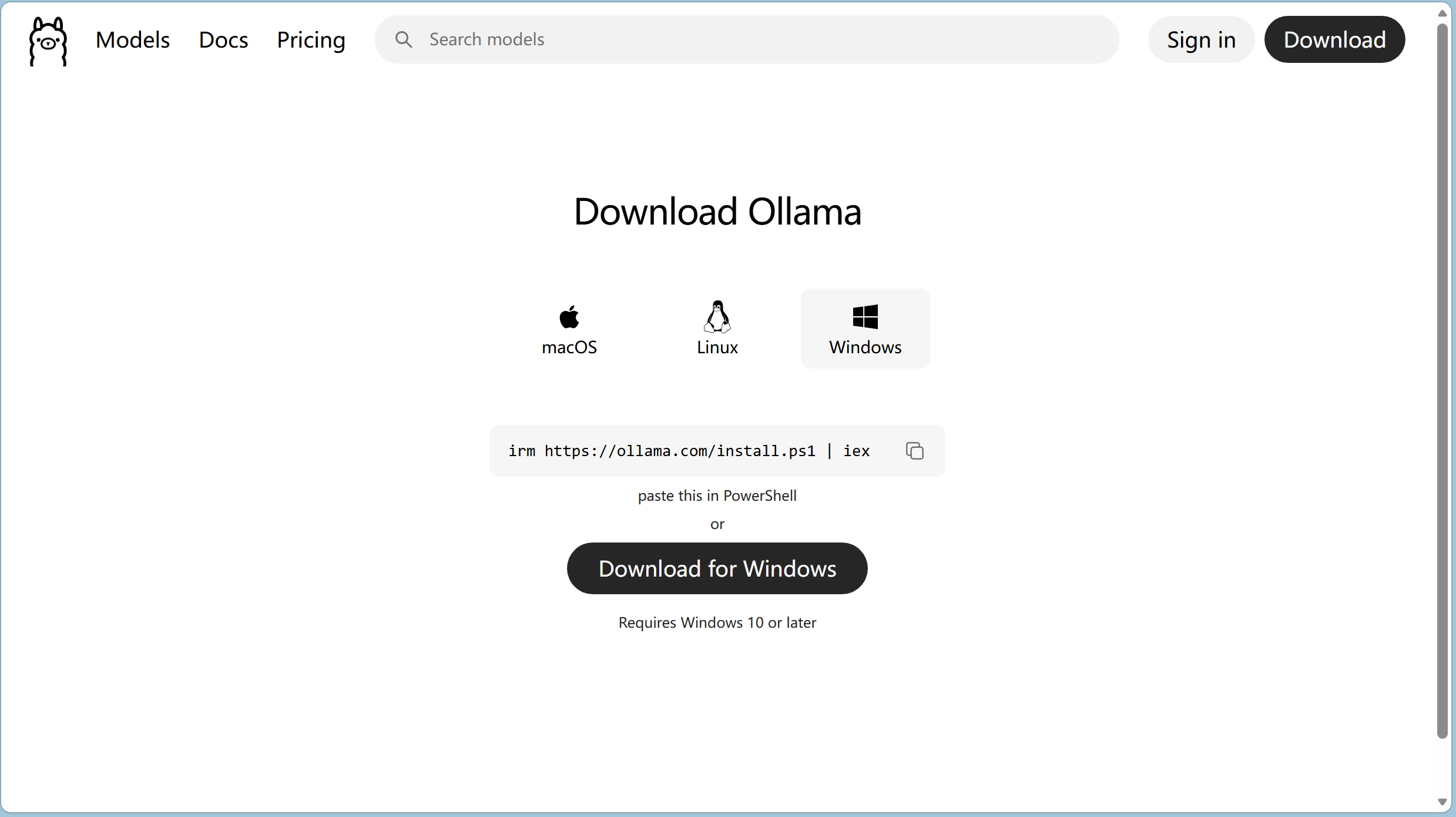

打开 Ollama 的官方下载页面:

这里有两种下载方式,一个是下载exe文件,还有一个是通过命令行下载,现在 Ollama 好像已经有自己的 UI 了,所以应该是下 exe 版本会更方便一点。

Step 2. 安装Ollama

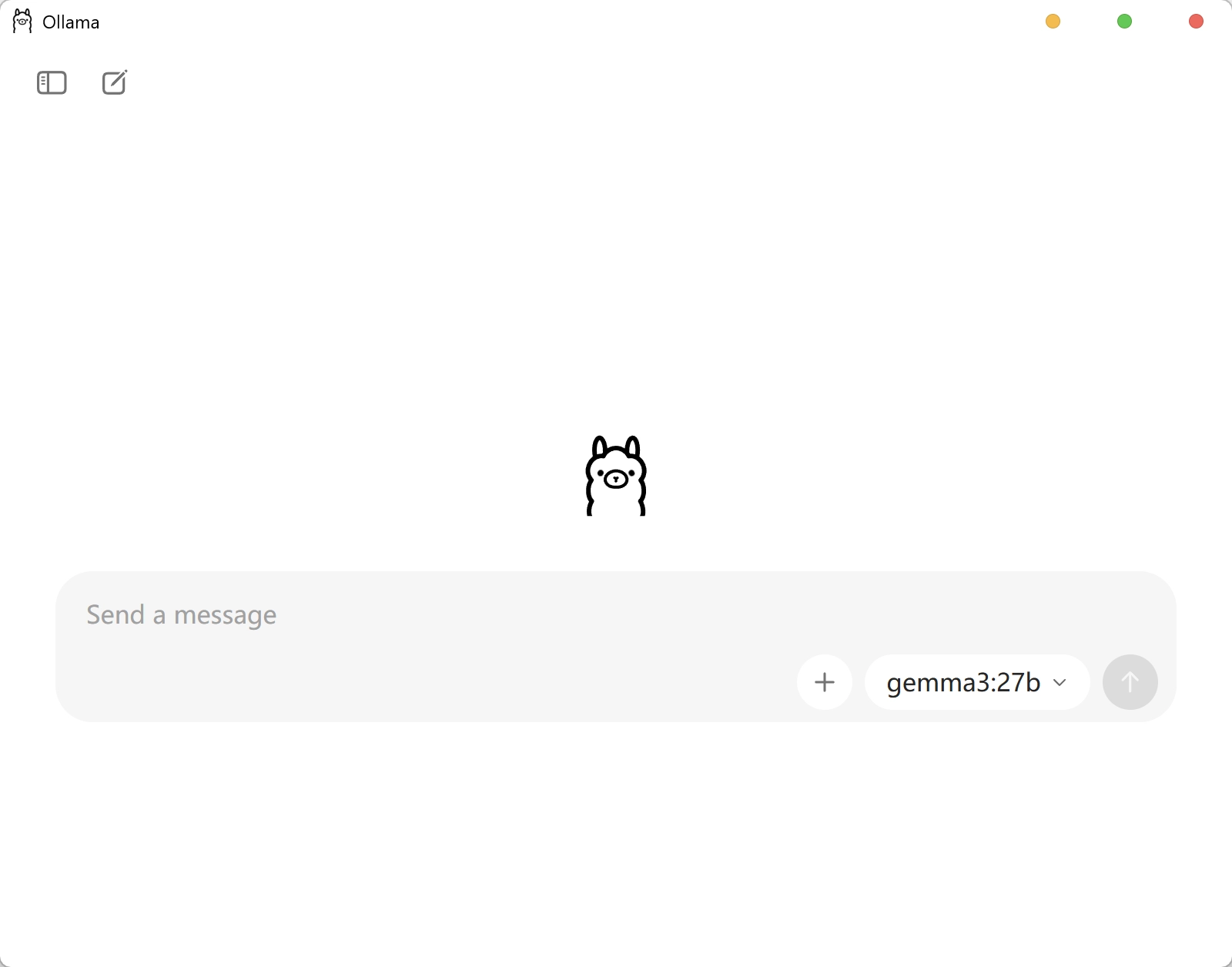

下载完 Ollama 之后就按正常的软件安装就行了,安装完之后就可以看到 Ollama 的 UI 界面了,这个 UI 界面还挺方便的,可以一键安装一些模型,还可以登录账号之后用云端的模型,但是它本身支持的模型不多,而且好像没有 deepseek(只有云端版),所以我们就先不用这个 UI 界面,还是用传统的命令行来操作。

Step 3. 更改大模型储存位置

默认情况下,Ollama 会把模型存放在C:\Users\用户名\.ollama\models,因为大模型普遍还是比较大的,一个大概4~400个G左右(deepseek r1),所以为了防止C盘爆满,建议还是最好把大模型放在D盘。

首先新建一个文件夹,记下该文件夹的位置(我的是D:\AI_Models\Ollama),这个文件夹最好不要用中文或者其他英语以外的语言,不要有空格,以防后面出现什么幺蛾子

然后在系统中搜索“编辑系统环境变量”,打开之后点击“环境变量”,新建一个环境变量:

变量名:

OLLAMA_MODELS变量值:

你刚刚创建的存放AI模型的文件夹(我的就是D:\AI_Models\Ollama)

保存之后,在任务托盘里面找到 Ollama 的图标,Quit 之后再出现打开,应用就生效了

Step 4. 下载Deepseek r1

打开 Ollama 的模型库,就可以看到 Ollama 支持的所有大模型,点击进去就可以看到下载运行的命令等,我这次选择的是 deepseek r1 的 7b 版本,这是最入门最推荐的尺寸,大概占5个G

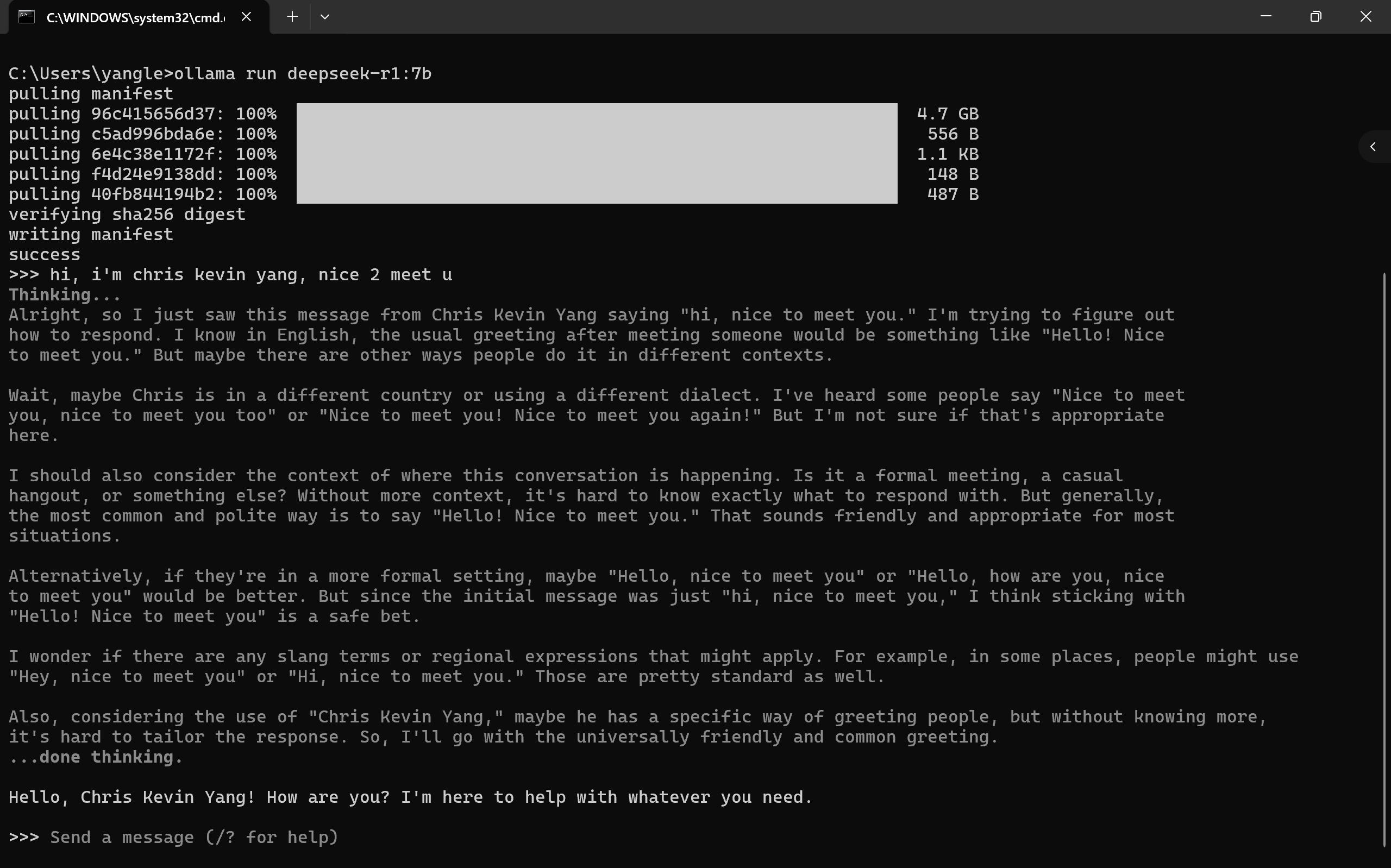

首先先用Win⌘ + R打开运行窗口,输入 cmd,打开命令提示符,然后运行

1 | ollama run deepseek-r1:7b |

运行完之后它就会自动开始下载 AI 模型以及配置,这里建议挂一个 VPN,下载稳定一点,等到下载完之后就可以开始对话了。输入/bye可以退出。

Step 5. Ollama 命令汇总

| 常用操作 | 命令 |

|---|---|

| 下载模型 | ollama pull [模型名] |

| 直接运行对话 | ollama run [模型名] |

| 列出已安装模型 | ollama list |

| 删除特定模型 | ollama rm [模型名] |

| 查看运行状态 | ollama ps |

更多命令:

Step 6. 使用图形化界面

如果你下载的是 exe 版本的 Ollama 的话,我们前面也说过 Ollama 现在是支持图形界面的,只要完成上面的步骤就可以在 Ollama 窗口的模型列表里面找到 Deepseek r1 开始对话,但是我觉得这个窗口还是有点简陋,不符合我的审美,所以我准备给 AI 安装一个前端页面。这里我有找到两个项目,一个是 Open WebUI,很精致,适合不那么要求自定义的人。 还有一个是 Ollama Web UI Lite,比较简单,是前面那个 Open WebUI 的简化版,可以通过 css 自定义页面样式。

注意下文提到的两种方式均会占用localhost:3000端口,如果同时运行可能会产生冲突,如果要同时用两个方案的话,建议在使用 Ollama Web UI Lite 运行npm run dev时在后面加上-- --port 3001以防止冲突

安装 Open WebUI

1. 安装 Docker Desktop

打开 Docker Desktop 的官方下载页面:

(注意:Docker Desktop 在 Windows 上通常依赖 WSL2(Windows Subsystem for Linux)或 Hyper-V,如果没有安装或者遇到报错的话建议检查一下 Hyper-V 有没有开启或者管理员运行 Power Shell 输入wsl --status检查一下,如果显示未安装的话则需要输入wsl --install进行安装。)

下载下来之后运行安装,安装好了之后在命令行输入下面的命令:

1 | docker pull ghcr.io/open-webui/open-webui:main |

等到所有文件都下载完毕之后,继续运行下一行命令:

1 | docker run -d -p 3000:8080 -v open-webui:/app/backend/data --name open-webui ghcr.io/open-webui/open-webui:main |

如果要开启单用户模式(无需登录),则换运行这条命令:

1 | docker run -d -p 3000:8080 -e WEBUI_AUTH=False -v open-webui:/app/backend/data --name open-webui ghcr.io/open-webui/open-webui:main |

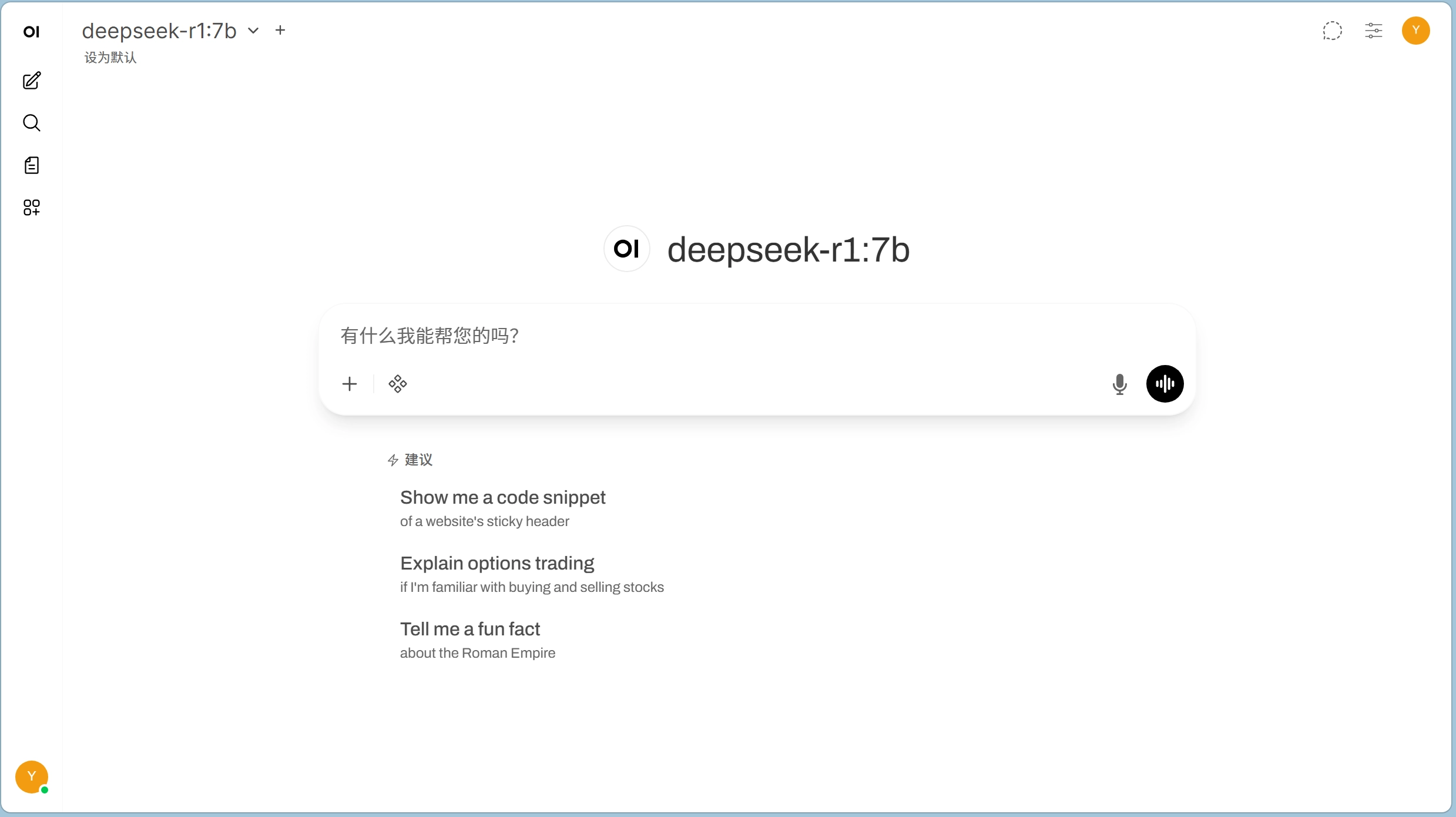

运行容器之后,访问 http://localhost:3000 ,就可以访问 Open WebUI 了。如果有报错页面或者无法进入的话建议等10~30秒再重试。第一个登录的账号会成为管理员账号。

2. 连接Ollama后端

一般来说进入到界面之后 Open WebUI 就会自动搜索到使用 Ollama 部署在电脑本地的 AI 并配置完毕了,只要在上方选择模型的地方选择你部署的模型即可,但是如果没有自动配置的话,可以点击头像 > 管理员面板 > 设置 > 外部连接,在 Ollama 接口一栏中填入http://localhost:11434/api,应该就可以配置好了。

3. 停止服务

如果要停止容器而不删除的话,请使用:

1 | docker stop open-webui |

如果要重启容器,请使用:

1 | docker start open-webui |

如果要停止并删除容器,请使用:

1 | docker stop open-webui |

或一步到位:

1 | docker rm -f open-webui |

4. 快速启动

新建一个.txt文件,复制粘贴以下内容:

1 | @echo off |

将文件名后缀改为.bat,双击就可以快速启动 Open WebUI 和 Ollama 了。此时会弹出一个命令行窗口,关闭窗口即可停止服务。为这个.bat文件创建一个快捷方式,打开快捷方式的属性 > 快捷方式 > 更改图标,给他换一个 Deepseek 的图标,放在桌面上就可以像其他软件一样了。

安装 Ollama WebUI Lite

1. 安装 Ollama Web UI Lite

新建一个文件夹,右键 Open Git Bash Here,在 git 中运行以下命令:

克隆仓库:

1 | git clone https://github.com/ollama-webui/ollama-webui-lite.git |

安装依赖:

1 | npm ci |

将应用置于开发模式:

1 | npm run dev |

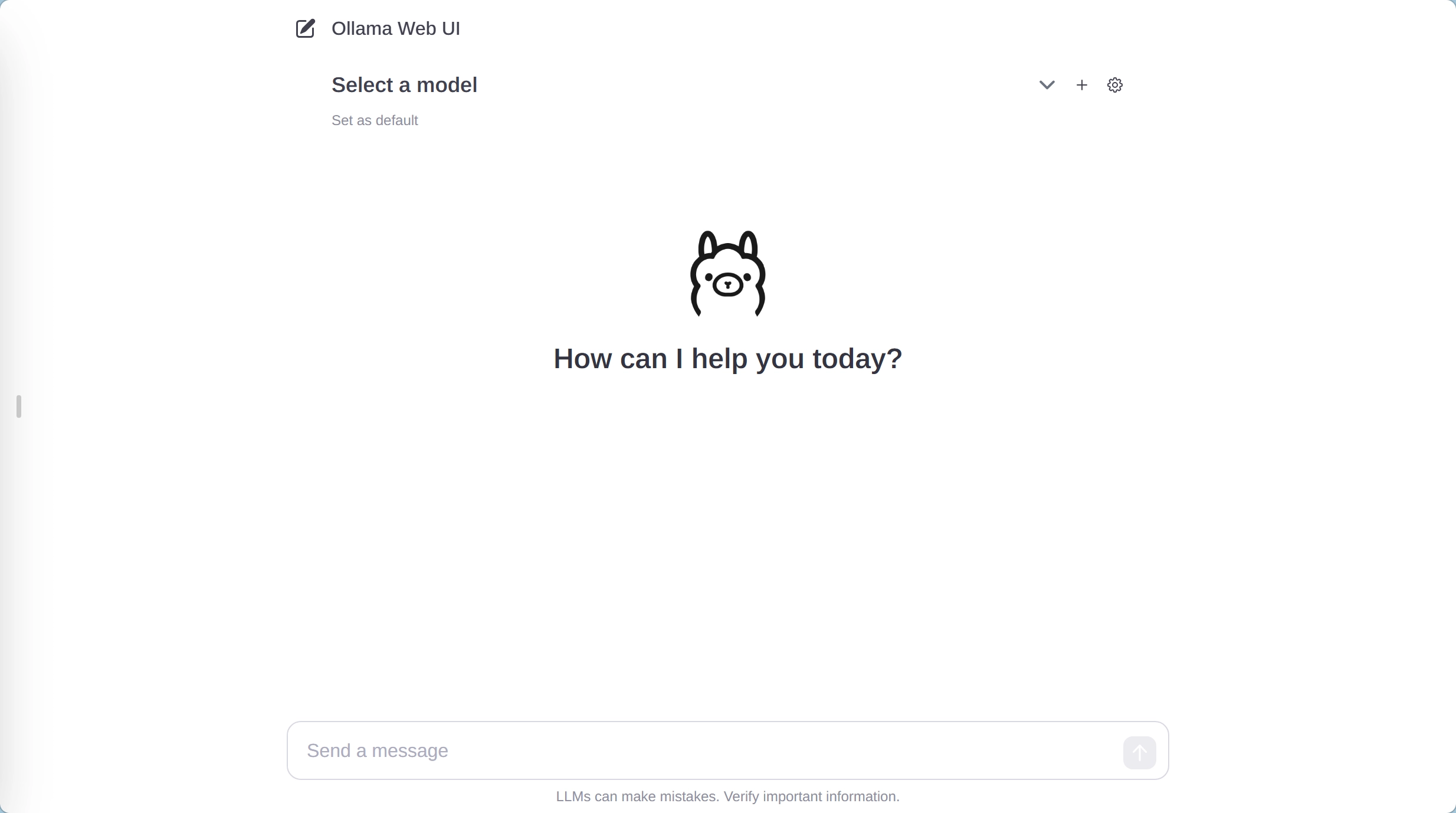

访问 http://localhost:3000 ,就可以看到 Ollama Web UI Lite 的界面了

2. 连接Ollama后端

一般来说进入到界面之后 Ollama Web UI Lite 就会自动搜索到使用 Ollama 部署在电脑本地的 AI 并配置完毕了,只要在上方选择模型的地方选择你部署的模型即可,但是如果没有自动配置的话,可以进入设置,在 Manage Ollama API Connections 一栏中填入http://localhost:11434,应该就可以配置好了。

3. 自定义样式

Ollama Web UI Lite 基于 Svelte 框架和 TypeScript 构建,并使用 Vite 作为构建工具,所以所有 Ollama Web UI Lite 的样式文件都在ollama-webui-lite/src这个文件夹里。这个文件夹下面的app.html就是最基础的 HTML 结构,tailwind.css则是全局 css 规则,各个组件的样式放在 lib/components/ 这个文件夹里的各个.svelte文件里。

下面是一些常用的样式与对应的文件对照表:

| 文件/目录 | 路径 | 主要用途 |

|---|---|---|

| HTML 入口 | src/app.html |

应用的基础 HTML 结构 |

| 全局 CSS | src/tailwind.css |

全局样式和 Tailwind 指令 |

| UI 组件 | src/lib/components/ |

存放所有界面组件的目录 |

| 工具函数 | src/lib/utils/ |

包含 API 连接等辅助函数 |

| 常量定义 | src/lib/constants.ts |

定义模型列表等全局常量 |

| 状态管理 | src/lib/stores/ |

管理对话历史、设置等应用状态 |

修改后保存刷新应该就可以看到效果

4. 快速启动

新建一个.txt文件,复制粘贴以下内容:

1 | @echo off |

将文件名后缀改为.bat,双击就可以快速启动 Ollama Web UI Lite 和 Ollama 了。此时会弹出一个命令行窗口,关闭窗口即可停止服务。为这个.bat文件创建一个快捷方式,打开快捷方式的属性 > 快捷方式 > 更改图标,给他换一个 Deepseek 的图标,放在桌面上就可以像其他软件一样了。

Step 7. 大功告成!

享受和在你电脑本地部署的AI聊天吧!